最近你是不是也被一系列“回答我”鬼畜视频刷屏?在各种社交软件上,明明上一秒还是一张静态照片,下一秒就能扭腰转身、街舞翻跳,甚至连兵马俑都能跳Kpop。

这些视频背后,用的就是最近爆火的AI工具——Viggle Ai

1

人人都能上手?

到底怎么玩

和 Runway、可灵那些“写文案生电影”型 AI相比,Viggle 更像是“动作版 P 图神器”:你丢一张图,它让图里的人活过来,不仅能跳舞,还能打拳、走台步,全靠动作模板或视频绑定。

在视频功能上,Viggle给我们提供了四种玩法:

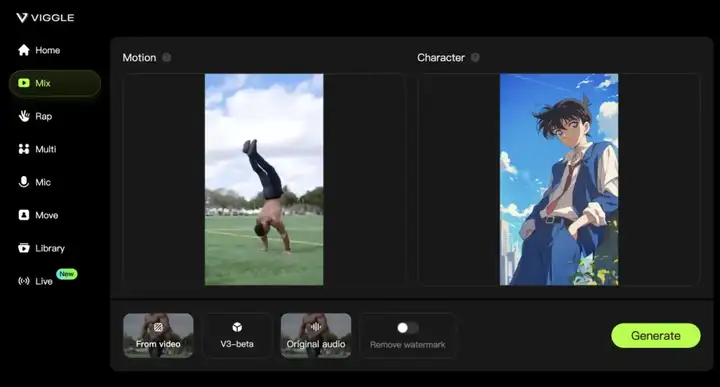

Mix——单人换脸

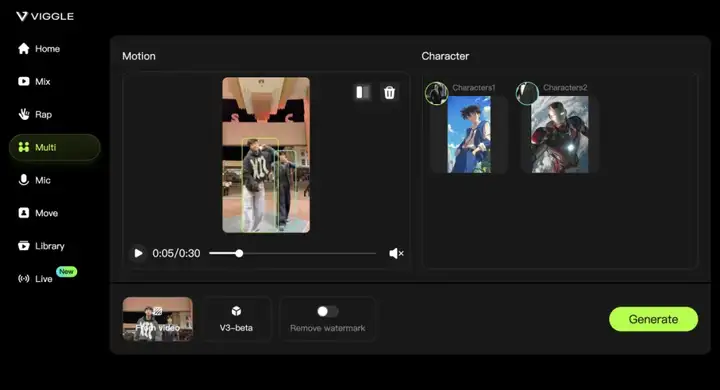

Multi——多人换脸

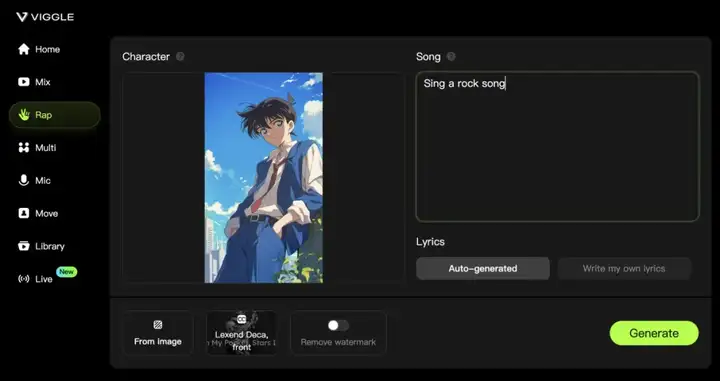

Rap——让指定角色演唱歌曲

Live——直播换脸

在Mix 模式下,我们可以将指定人物的脸换到一段参考视频中,比如让柯南在足球场上跳街舞:

从生成结果来看,视频画质和人物流畅度虽然与真实拍摄效果相比有较大差异,但也足以满足用户的娱乐需求。

使用Rap功能,可以让柯南唱摇滚:

在多人(Multi)模式下,可以让柯南和钢铁侠共舞:

最近,Viggle还推出了全新Live功能,主打“用一张图片+摄像头”实时生成虚拟主播,起步价为 24.99 美元/月(约人民币170元),支持约2小时的直播时长,用户只需上传人物形象图并开启摄像头,系统即可自动识别动作并将其“转化”为虚拟角色,操作零门槛,不需建模或动画基础。

(素材来源于网络)

从测试视频中可以看出,该功能的大动作同步较为准确,延迟在1~2秒之间,表情识别不算精准,但基础表情还原得还算自然,但在快速移动时偶有闪烁和细节模糊。优点在于门槛低、上手快、形象自由度高,适合内容创作者快速生成角色视频;缺点则包括画质细节偏弱、互动能力有限。

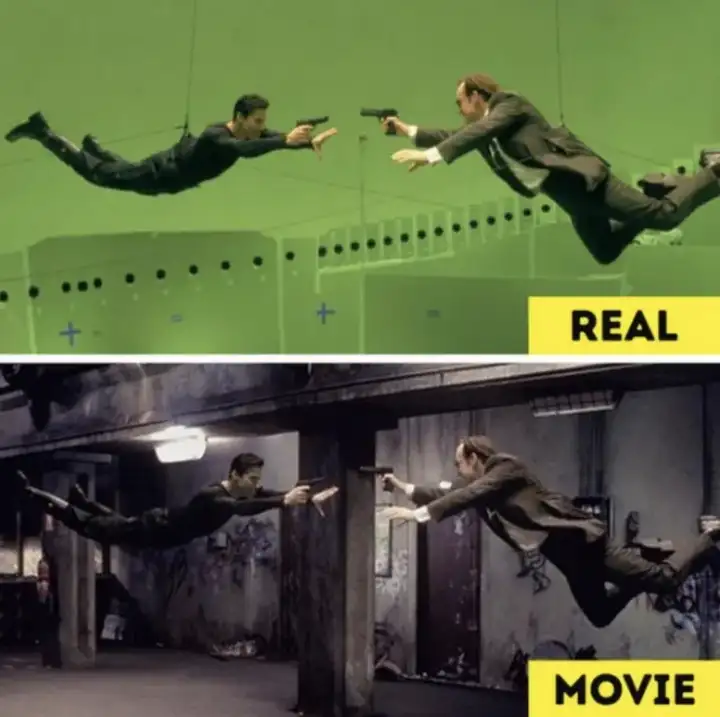

《黑客帝国》尼奥大战史密斯

与好莱坞的动作捕捉技术相比,虽然在精度、稳定性、表情还原和数据输出上仍有明显差距,无法满足电影级制作对每一帧动作和表情细节的严苛要求,但这一技术的出现,为短视频、剧情演绎、直播换皮等轻内容场景提供了简单易上手的“平民版动捕”,未来或许还会成为影视创作中的快速预演工具。

2

Viggle AI爆火

背后逻辑是“低门槛+高社交”

Viggle 的成功,归根结底是因为它打通了 AI 工具与用户之间的那道墙。普通人用 AI,最怕两件事:不会用、效果差。Viggle 全面避开这两个痛点——操作简单到可以只需要“拖拽+点击”就完成制作。再加上它鼓励创作者模仿、混剪、用照片整活,很快就形成了以“照片跳舞”为代表的社交生态。

另外在创作思路上,Viggle和市面上许多AI视频模型也完全不同。以目前比较受欢迎的可灵为例:

可灵是导演型:

你写一句话,它构建一个场景,强调叙事和氛围;

而Viggle 是表演型:

你给一个角色,它就帮你把动作做出来,强调控制感和拟真度。一个偏虚构世界,一个偏个性表达,一个面向较专业的视觉制作用户,一个被常用于满足社交需求。

3

AI越“懂你”

就越值得警惕

就目前来看,AI 正在以前所未有的速度融入我们的生活。

它能帮我们生成文案、分析数据、合成图像、合成声音,甚至像 Viggle AI 那样,用一张照片就让任何人“跳”起来。从表面看,这是一场效率与创意的狂欢,是一场“人机”共创;但在它快速理解你、模仿你、重建你的过程中,也悄然改变了一个事实:我们的隐私不再是隐私。

这些Ai 并不是明抢用户的数据,而是通过流程设计让你“主动”上传——一张图、一段语音、一句提示词,背后都是你的面孔、声音、偏好、语言习惯,甚至是情绪和人设。这些内容,有的用来生成,有的用来优化算法,有的则可能在你毫不知情的情况下,被保留、复制,甚至转售。

截至目前就有不少AI平台曾因“数据使用不透明”被用户公开质疑:

Viggle AI 被多位用户指出其生成的视频链接在用户删除内容后依然可访问,怀疑平台存在通过后台缓存用户数据的机制;

Zoom 在 2023 年被曝光将用户的音视频数据用于训练自家语音识别模型,引发严重舆论反弹,最终被迫修改服务条款;

Stability AI、Midjourney被数百名插画师集体起诉,原因是其在未经授权的前提下收集艺术家作品作为训练数据;

Meta 更是曾将数十亿张 Facebook 和 Instagram 用户头像图片输入其面部识别系统,事后用户几乎无从追溯或撤销;

甚至连 Google 的 Gemini也被曝在训练过程中抓取了大量 YouTube 频道主未公开同意的数据内容。

这些案例背后透露的共同逻辑是:AI 越想变得“聪明”,就越需要大量、真实、多样的用户数据,而普通用户往往在毫不知情的情况下被当作模型的训练燃料。

许多用户把AI当作“知己”,并没有意识到自己的隐私正在被窃取,但现实是:在主流AI 平台中,默认收集、默认训练、默认共享的情况屡见不鲜。

比如ChatGPT 虽然允许用户关闭数据记录,但该设置被隐藏在多层菜单中;Google的Gemini则默认将用户输入的内容用于“产品改进”;而像Viggle这类图像创意型工具,用户上传的图片甚至在删除后仍可能被访问。

对于我们普通用户来说,这是一种“看不见的被动参与”。

这种缺乏行业共识的处理方式,让用户在使用 AI 工具时几乎毫无议价能力,我们的图像、声音、偏好、语气,甚至生活轨迹被训练进一个又一个模型,AI在完成指令的同时,也正在扫描你、再造你。

因此,在享受高效的同时,我们需要重新审视“技术便利”与“隐私成本”之间的关系。

AI工具的大众化应该建立在尊重用户选择权的基础之上。平台应当明确标注训练范围,提供真正有效的“退出”按钮;政策层面也需设立适用于 AI 场景的用户隐私保护机制,让技术的发展不以牺牲信任为代价。

如果说 AI 的未来是人人可用的创作工具,那么隐私的底线就是让每个人都知道:你正在提供什么,你能拒绝什么,你有权删除什么。只有这样,我们才能在享受 AI 便利的同时,不被数据克隆出另一个自己。